KI-Blog

Artikel zu Machine Learning, LLM, Suche & Text Mining

Scheren Sprachmodelle kaum um sich Wortreihenfolge

17.02.2026

Warum ist für Sprachmodelle Wortreihenfolge oft optional? Erfahre, wie DroPE & RoPE die Architektur beeinflussen und was das für Long-Context-LLMs bedeutet.

Warum KI-Suche scheitert: Die Grenzen von Vector Retrieval

12.01.2026

Warum scheitert die Vektor-Suche an Fakten? Erfahren Sie alles über die Grenzen von Embeddings & warum hybride Systeme für Unternehmen unverzichtbar sind.

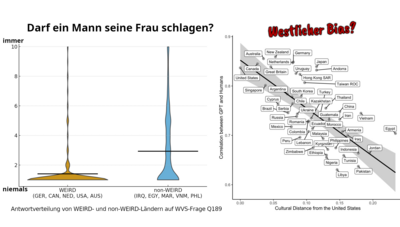

ChatGPT ist WEIRD

25.11.2025

Warum ChatGPT ist WEIRD: Eine Studie zeigt, dass KI-Modelle westliche Werte spiegeln. Erfahren Sie mehr über kulturellen Bias und LLM-Ethik. Jetzt lesen!

Chinas Aufstieg zur Open Source KI-Dominanz

22.09.2025

Chinesische KI-Agenten dominieren Hugging Face. Erfahren Sie alles über DeepSeek, Qwen & Co. und die Forschungsinnovationen hinter Chinas Erfolg.

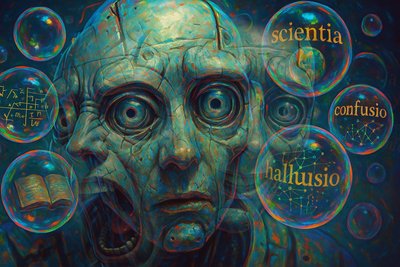

OpenAI ohne Lösung für Halluzinationen

22.09.2025

Warum entstehen KI Halluzinationen? OpenAI untersucht statistische Ursachen in LLMs. Erfahren Sie alles über das IIV-Modell & fehlerhafte Benchmarks.

KI-Agenten: Zwischen Assistent und Autonomie

09.09.2025

Was sind KI-Agenten wirklich? Erfahren Sie alles über Autonomie, Human-in-the-loop und praktische Anwendungsfälle für Ihr Unternehmen. Jetzt Blog lesen!

Was GPT-5s Mathefehler wirklich zeigen – und was nicht

14.08.2025

Warum machen Sprachmodelle KI Mathefehler? Erfahren Sie alles über Tokenisierung, Attention-Limits und warum Rechenfehler kein Beweis gegen Logik sind.

Neofonie erfolgreich nach ISO 27001:2022 zertifiziert

30.07.2024

Neofonie erhält die ISO 27001 Zertifizierung. Erfahren Sie, wie wir Informationssicherheit & Datenschutz in der Softwareentwicklung garantieren. Jetzt lesen

Können Sprachmodelle schlussfolgern?

14.07.2025

Können Sprachmodelle schlussfolgern? ontolux analysiert Chain-of-Thought & Reasoning-Traces. Erfahren Sie die Wahrheit über das KI-Schlussfolgern im Blog.

Projektstart von TSS MoVe

10.07.2025

TSS MoVe revolutioniert die Technologierecherche im Verkehrssektor. ontolux entwickelt mit Partnern ein automatisiertes Scouting-System für Mobilität.

KI und Datenschutz

30.06.2025

KI und Datenschutz vereinen: Erfahren Sie, wie Sie DSGVO-konforme KI-Strategien entwickeln, Innovationen fördern und die Datenkontrolle behalten.

Der digitale Rosetta-Stein: Universelle Semantik in Sprachmodellen

03.06.2025

Was sind Text Embeddings? ontolux analysiert das vec2vec-Verfahren: Wie unterschiedliche Modelle eine gemeinsame semantische Struktur teilen. Jetzt lesen!

KI-Agenten im Peer Review: Automatisierte Forschung und ihre Grenzen

02.05.2025

Wie weit geht automatisierte Forschung? Ein KI-Agent schreibt ein Paper und besteht den Peer Review. ontolux analysiert Chancen & Risiken für Wissenschaft.

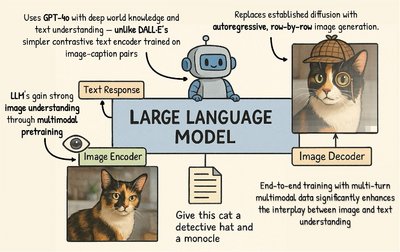

Die neue KI-Bildgenerierung von OpenAI

02.04.2025

Wie funktioniert die neue KI-Bildgenerierung von OpenAI? Wir analysieren GPT-4o, VAR & DeepSeek Janus-Pro. Erfahren Sie alles über die Technik dahinter!

Wie eine bessere Suche den Support revolutioniert

28.03.2025

Wie optimiert Self-Service-Support den Kundenservice? Erfahren Sie, wie intelligente Suche Tickets reduziert und Kunden glücklicher macht. Jetzt lesen!

Generative KI richtig bewerten

13.03.2025

Wann lohnt sich der Einsatz? Erfahren Sie, wie Sie Generative KI bewerten, welche Anwendungsfälle für Unternehmen sinnvoll sind und was Agentic AI leistet.

Reasoning-Modelle

28.02.2025

Was sind Reasoning-Modelle? Erfahren Sie, wie DeepSeek R1 & OpenAI o3 durch RL lernen und was sie von AlphaZero unterscheidet. Jetzt lesen!

10 Tipps, für eine erfolgreiche Suche im E-Commerce

14.04.2026

Wie Sie Ihre Produktsuche im E-Commerce optimieren: Diese Checkliste bietet 10 Profi-Tipps für mehr Conversions und zufriedene Kunden. Jetzt lesen!

Werden Sprachmodelle immer dümmer?

14.04.2026

Sinkt die Sprachmodelle Qualität bei ChatGPT & Co. wirklich? Erfahren Sie, warum psychologische Effekte unsere Wahrnehmung von KI trügen. Jetzt lesen!

Suchqualität im E-Commerce: Der geheime Hebel für mehr Umsatz

14.04.2026

Warum ist Suchqualität im E-Commerce entscheidend? Erfahren Sie, wie Sie die Produktsuche optimieren und die Conversion-Rate steigern. Jetzt lesen!

KI-Modell o3 von OpenAI und der ARC-AGI-Benchmark

14.04.2026

Erreicht OpenAI o3 mit 87,5 % die AGI? Erfahren Sie alles über den ARC-AGI Benchmark, die Fortschritte von o3 und die Grenzen der KI-Forschung. Jetzt lesen!

LLM Hosting - cloud, on-premise oder hybrid?

14.04.2026

Cloud, On-Premise oder Hybrid? Finden Sie das ideale LLM Hosting für Ihr Unternehmen. Unser Whitepaper analysiert Kosten, Datenschutz & Performance.

KI-Sprachmodelle: Live- vs. zyklische Anwendungen

14.04.2026

Welche KI-Anwendungen passen zu Ihnen? Wir vergleichen Live- und zyklische Systeme in Bezug auf Latenz, Kosten und Infrastruktur. Jetzt bei ontolux lesen!

Strukturierter Output und strukturierte Generierung

14.04.2026

Strukturierte Generierung vs. strukturierter Output: Erfahren Sie alles über JSON-Formate, Outlines & LLM-Pipelines. Jetzt im ontolux Blog lesen!

KI-Hardware: Was für den Betrieb von Künstlicher Intelligenz nötig ist

14.04.2026

Was steckt hinter KI-Hardware? GPUs, CPUs & Speicher erklärt im Weihnachts-Check. Erfahren Sie alles über die Technik für Künstliche Intelligenz.

Nvidia Minitron: LLMs verkleinern und Kosten sparen

14.04.2026

Nvidia Minitron kombiniert Pruning und Knowledge Distillation. Erfahren Sie, wie Sie LLMs verkleinern, um Hardwarekosten zu senken und lokal zu deployen.

Multimodale LLMs: Wenn LLMs sehen und hören lernen

14.04.2026

Was sind multimodale LLMs? Erfahren Sie, wie GPT-4o & Llama 3.2 Bilder oder Audio verarbeiten. Technik, Komponenten und Open-Source-Trends im Überblick.

LLMs im Vergleich

14.04.2026

Ein fundierter LLMs im Vergleich ist essenziell für Ihre KI-Strategie. Unser Whitepaper analysiert Kosten, Datenschutz & Performance. Jetzt kostenlos laden!

Speculative Decoding

14.04.2026

Was ist Speculative Decoding? Erfahren Sie, wie diese Methode die KI-Textgenerierung beschleunigt, ohne die Qualität zu mindern. Jetzt bei ontolux lesen!

ontolux stellt KI-Sprachmodelle bei medianet KI-Sprechstunde vor

14.04.2026

Erfahren Sie mehr über moderne KI-Sprachmodelle: ontolux-COO Bertram Sändig im Expertengespräch bei medianet. Inklusive Whitepaper zum Modell-Vergleich!

Künstliche Intelligenz und Ethik

14.04.2026

Wie gelingt KI-Ethik? Erfahren Sie alles über Verantwortung, Bias-Prävention und den EU AI Act in unserem Leitfaden. Jetzt informieren!

Optimierung von RAG-Systemen durch Selbstreflexion

14.04.2026

Wie lassen sich RAG-Systeme optimieren? Erfahren Sie alles über Self-Reflective RAG, Adaptive-RAG und Wege zu präzisen KI-Antworten. Jetzt lesen!

Der European AI-Act und die Folgen für Unternehmen

11.06.2024

Was bedeutet der European AI Act für Ihr Unternehmen? Wir analysieren Risikostufen, Pflichten und Chancen der neuen EU-KI-Verordnung. Jetzt informieren!

Mit Kahneman-Tversky-Optimization Chatbots verbessern

14.04.2026

Was ist Kahneman-Tversky-Optimization (KTO)? Wir vergleichen KTO mit RLHF & DPO und zeigen, wie Sie Chatbots effizienter trainieren. Erfahren Sie mehr!

Retrieval Augmented Generation für Fortgeschrittene - LLM Kontextfenster

14.04.2026

RAG für Fortgeschrittene: Erfahren Sie alles über LLM-Kontextfenster, den Lost-in-the-Middle-Effekt und wie Sie Halluzinationen vermeiden. Jetzt lesen!

Wie gut sind Sprachmodelle im Deutschen?

14.04.2026

Wie gut performen Sprachmodelle im Deutschen? Wir testen LLMs wie Llama & Mixtral auf deutschen Benchmarks und erklären die Perplexität. Jetzt lesen!

Learning to rank: Mit Machine Learning zu besseren Suchergebnissen

14.04.2026

Wie verbessert Learning to Rank in Solr die Suchergebnisse? Erfahren Sie alles über Machine Learning, Features & Evaluierung in Apache Solr. Jetzt lesen!

Large Language Models verbessern sich selbst

14.04.2026

Können Large Language Models sich ohne neue Daten selbst verbessern? Wir stellen Self-Rewarding Language Models vor & analysieren DPO-Zyklen. Jetzt lesen!

Grundsätze zur Verbesserung von Prompts

29.01.2024

Wie lassen sich Prompts verbessern? Wir stellen 26 wissenschaftliche Prinzipien für GPT & Llama vor. Jetzt Tipps für besseres Prompting lesen!

Längere Kontexte und externes Wissen mit LLMs

04.12.2023

Wie steigert man die Kontextlänge von LLMs? Wir vergleichen RAG, LongLoRA und Graph of Thoughts im KI Journal Club. Jetzt technische Einblicke lesen!

ontolux auf der BMBF-Mittelstandskonferenz in Berlin

08.11.2023

ontolux präsentiert die Projekte Text2Tech & AI4SCM auf der BMBF-Mittelstandskonferenz 2023. Erfahren Sie mehr über KI-Innovationen im Mittelstand.

Global TechMining Conference: Vorstellung des Forschungsprojekts "Text2Tech"

30.10.2023

Besuchen Sie die Global TechMining Conference 2023. ontolux präsentiert das Projekt Text2Tech zur KI-basierten Technologiebeobachtung. Jetzt mehr erfahren!

Warum wir Prompt-Engineering noch brauchen

24.11.2023

Ist Prompt-Engineering noch nötig? Erfahren Sie, wie RLHF Sprachmodelle formt und warum präzise Prompts für Experten-Ergebnisse unverzichtbar sind.

LLM Llama 2 von Meta

29.08.2023

Was kann Llama 2? Wir analysieren Metas Open-Source-LLM: Von Modellgrößen (7B bis 70B) über Sicherheit bis zur Performance. Jetzt lesen!

Neofonie erhält Deep Tech Award 2023

06.07.2023

Neofonie gewinnt den Deep Tech Award 2023 in der Kategorie IT-Security. Erfahren Sie mehr über das Projekt mit dem BSI und das Framework TXTWerk.

Aufbau einer intelligenten Suche

06.06.2023

Wie gelingt eine intelligente Suche? Erfahren Sie alles über Aufbau, die Nutzerführung und Ranking-Optimierung für Ihre intelligente Suche im Unternehmen.

ontolux bei der Mind Mastering Machines 2023

26.04.2023

Besuchen Sie ontolux auf der Mind Mastering Machines 2023! Bertram Sändig spricht über ML & Ontologien für die IT-Sicherheit. Jetzt Details lesen!

Neues Forschungsprojekt: AI4SCM

31.03.2023

Das Projekt AI4SCM nutzt KI zur Früherkennung von Supply Chain Risiken. Erfahren Sie, wie ontolux Lieferketten durch NLP & Machine Learning absichert.

Deep Learning - Funktionen und Anwendungsbeispiele

15.03.2023

AlphaGo und DeepFace haben Deep Learning bekannt gemacht. Was sind die Möglichkeiten? Wir geben einen Überblick über Deep Learning und Machine Learning.

AI-Tools auf dem Prüfstand

30.11.2022

Welche AI-Tools überzeugen? Erfahren Sie mehr über Galactica, Stable Diffusion V2 und die Risiken von Softwarefehlern im KI Journal Club. Jetzt lesen!

Autonomes Fahren auf dem Rückzug

31.10.2022

Ist autonomes Fahren am Ende? Der KI Journal Club über das Aus von Argo AI, neue Rekorde bei der Matrixmultiplikation und Bias in Sprachmodellen.

Was ist Natural Language Processing?

10.10.2022

Was ist Natural Language Processing? Erfahren Sie alles über NLP-Funktionen, Herausforderungen und Praxisbeispiele im großen ontolux Guide. Jetzt lesen!

KI Made in Germany

30.09.2022

Wie steht es um KI Made in Germany? Erfahren Sie mehr über die LEAM-Initiative, Aleph Alpha und aktuelle Trends im ontolux KI Journal Club. Jetzt lesen!

Wie gefährlich ist KI?

31.08.2022

Wie groß sind die Gefahren von KI wirklich? Der ontolux Journal Club über Eric Schmidts Atombomben-Vergleich, Deepfakes und Bias in DALL-E 2. Jetzt lesen!

Rückblick - ontolux Vorträge bei der M3 und der Berlin Buzzwords

18.07.2022

ontolux stellte Methoden für ressourcensparende KI-Modelle bei der Minds Mastering Machines und Berlin Buzzwords im Juni 2022 vor.

NLP Summer School

29.07.2022

Lernen Sie KI am Strand! Unsere NLP Summer School bietet Notebooks, Lesetipps von Gary Marcus und spannende Ressourcen für Natural Language Processing.

ontolux bei der Berlin Buzzwords 2023

13.06.2022

Erfahren Sie mehr über den ontolux-Vortrag auf der Berlin Buzzwords 2023: Machine Learning & Ontologien für die IT-Sicherheit. Jetzt lesen!

Emotionen und Language Models

30.06.2022

Können Language Models Emotionen zeigen? Der ontolux Journal Club über LaMDA, GPT4Chan und Microsofts Emotionserkennung. Jetzt lesen!

Kickoff des dreijährigen Forschungsprojekts Text2Tech

27.06.2022

Start für das Forschungsprojekt Text2Tech: ontolux, DFKI und inpro entwickeln KI-Methoden zur automatisierten Technologiebeobachtung. Jetzt mehr erfahren!

KI in der Justiz

30.05.2022

Helfen Algorithmen bei Urteilen? Wir analysieren KI in der Justiz, Googles Bild-KI Imagen und News zu Elastic & Hugging Face im Journal Club. Jetzt lesen!

Die neuen ML-Modelle DALL-E 2 und PaLM

29.04.2022

Erfahren Sie alles über DALL-E 2 und PaLM. Der ontolux Journal Club analysiert Reasoning, Chain of Thought Prompting und Bildsynthese. Jetzt lesen!

Entity Linking mit Doccano und TXTWerk (ontolux Fork)

22.04.2022

Wie gelingt Entity Linking? ontolux integriert Doccano in TXTWerk für effizientes Labeling und Disambiguierung. Entdecken Sie unseren Workflow!

Bias und KI

31.03.2022

Welche Risiken birgt Bias in KI-Systemen? Der ontolux Journal Club analysiert Predictive Policing, Rechenschaftspflicht und neue GPU-Hardware. Jetzt lesen!

Language Models und Ethik

28.02.2022

Wie beeinflussen Bias und toxische Sprache die KI? Der ontolux Journal Club analysiert Language Models und Ethik, InstructGPT und KI-Coder wie Alphacode.

Natural Language Processing mit dem Wikidata Knowledge Graph

28.02.2022

Erfahren Sie, wie ontolux den Wikidata Knowledge Graph für NLP & Machine Learning nutzt. Details zum Vortrag bei den Data Reuse Days 2022 hier.

ontolux bei der Mind Mastering Machines 2022

28.02.2022

Besuchen Sie ontolux auf der Mind Mastering Machines Messe in Karlsruhe! Erfahren Sie alles über ressourcensparende KI-Modelle durch Knowledge Distillation.

ChatGPT im Realitätscheck

23.02.2022

Was kann ChatGPT wirklich? Erfahren Sie im ChatGPT im Realitätscheck alles über die Funktionsweise, Grenzen und den Nutzen für Unternehmen. Jetzt lesen!

Zur Bedeutung des beutellosen Staubsaugers für die Intelligente Suche

14.02.2022

Was verbindet beutellose Staubsauger mit der Intelligenten Suche? Wir erklären mit einem Augenzwinkern, wie moderne Suche funktioniert. Jetzt lesen!

Lucence 9

31.01.2022

Lucene 9 revolutioniert die Suche mit Vektor-Indizierung. Erfahren Sie mehr über HNSW-Algorithmen und die Data Science Bedürfnispyramide im Journal Club.

Modellkomprimierung: Methoden zur Ressourceneinsparung von KI-Modellen

17.01.2022

Effiziente KI: Entdecke Methoden zur Modellkomprimierung wie Pruning & Knowledge Distillation, um Energie und Kosten bei Deep Learning Modellen zu sparen.

Question Answering bei Language Modellen

30.12.2021

Wie verlässlich ist Question Answering bei Language Modellen? Wir analysieren TruthfulQA-Benchmarks, GPT-3 Ergebnisse und den State of AI Report

Neuronale Netze für NLP

07.12.2021

Vergleich der Top-Modelle: Erfahren Sie alles über neuronale Netze für NLP wie BERT, RoBERTa & XLNet hinsichtlich Größe, Leistung und Energieeffizienz.

Fortschritte in der KI

30.11.2021

Aktuelle Fortschritte in der KI: Rückblick auf das Heidelberg Laureate Forum, GPT-3 News & UNESCO Ethik-Prinzipien im ontolux Journal Club.

Deutschsprachige NLP Frameworks unter der Lupe

19.11.2021

Welches ist das beste deutschsprachige NLP-Framework? Wir vergleichen 23 Anbieter wie Google, IBM & ontolux in unserem Whitepaper. Jetzt Analyse lesen!

MICES 2021: Warum eine goldstandard-basierte Evaluation?

16.04.2026

Warum ist eine goldstandard-basierte Evaluation wichtig? ontolux zeigt auf der MICES 2021, wie Suchsysteme in Kundenprojekten nachhaltig optimiert werden.

Neues Language Modell MT-NLG

31.10.2021

Das neue Language Modell MT-NLG bricht Rekorde: 530 Mrd. Parameter von Microsoft & NVIDIA. Erfahren Sie alles über Pytorch 1.10 und die Zukunft der Suche.

Idee der Foundation Models

30.09.2021

Was verbirgt sich hinter der Idee der Foundation Models? Der ontolux Journal Club analysiert LLMs, stochastische Papageien und die Zukunft der Arbeit.

Weil Vorbeugen besser als Heilen ist: Goldstandard für kundenspezifische Suchlösungen

14.09.2021

Wie optimiert man Suche mit einem Goldstandard für Suchlösungen? Erfahren Sie alles über Evaluation, Recall und Suchsysteme in unserem neuen Whitepaper.

Neues Forschungsprojekt: Semantische Begriffsanalyse für Information Retrieval Aufgaben (SEBIRA)

27.08.2021

ontolux startet SEBIRA: Wie Semantische Begriffsanalyse und Transformer-Architekturen das Information Retrieval für Unternehmen revolutionieren. Jetzt lesen

Hype um große Sprachmodelle

30.07.2021

Der ontolux Journal Club analysiert große KI-Sprachmodelle: Von GPT-3 bis Wu Dao 2.0. Erfahren Sie alles über multimodale Trends & europäische Alternativen.

Unnatürliche Sprachinferenz

30.07.2021

Verstehen NLP-Modelle Syntax? Der ontolux Journal Club analysiert die Unnatürliche Sprachinferenz, ACL-Erkenntnisse & digitale Verwaltung. Jetzt lesen!

EM 2020: Fußball für alle

28.07.2021

Wie reagiert die Social Media Community auf die EM? Erfahren Sie alles in unseren EM Spieltag-Analysen mittels TXTWerk Sentiment-Analyse & Elasticsearch

Google und KI

30.06.2021

Neuigkeiten zu Google und KI: Erfahren Sie alles über LaMDA, MUM und das KELM-Paper. Außerdem: Aktuelle FuE-Studien und die Zukunft der Arbeit mit KI.

EU Regelwerk für KI

31.05.2021

Die EU definiert ein neues EU Regelwerk für KI. Erfahren Sie alles über Risikostufen, den AI Act, KI-Updates für Wikipedia und ONNX 1.9 im Journal Club.

KI im deutschen Mittelstand

30.04.2021

Wie relevant ist KI im Deutschen Mittelstand? Wir analysieren die Deloitte-Studie, KI-Honeypots gegen Hacker und wie das Gehirn Sprache verarbeitet.

Mit Trivy mehr Sicherheit für TXTWerk

05.03.2021

Wie wir mit Trivy maximale Sicherheit für TXTWerk garantieren: Erfahren Sie alles über CVE-Scans, CI/CD-Pipelines und den Schutz vor Cyberangriffen.

TXTWerk hat Recht

26.02.2021

TXTWerk erkennt jetzt Paragrafen und rechtliche Referenzen automatisch. Erfahren Sie alles über unsere neue Legal NER Komponente und die API-Integration.

Selbstlernende Chatbots programmieren

27.01.2021

Tutorial: Selbstlernende Chatbots programmieren mit RASA & TXTWerk. Schritt-für-Schritt Anleitung zur intelligenten Intent-Erkennung & Elasticsearch.

Kategoriefilter

KI Blog: Einblicke in die Welt von NLP und Text Mining

Aktuelle Trends, technische Deep-Dives und Neuigkeiten aus unserer Forschung.

Willkommen in unserem KI Blog. Hier teilen unsere Experten ihr Wissen aus über 20 Jahren Erfahrung in der Entwicklung intelligenter Systeme. Daher finden Sie hier regelmäßig Analysen zu Themen wie Neural Search, Large Language Models und automatisierter Inhaltserschließung.

Wir orientieren uns dabei konsequent an den neuesten wissenschaftlichen Standards, wie sie regelmäßig auf Plattformen wie arXiv.org veröffentlicht werden. Infolgedessen schlagen unsere Beiträge die Brücke zwischen aktueller NLP Forschung und dem praktischen Einsatz in unseren KI Use Cases.