Wir starten in der aktuellen Ausgabe mit unserem Lieblingsthema: Wie gefährlich ist KI?

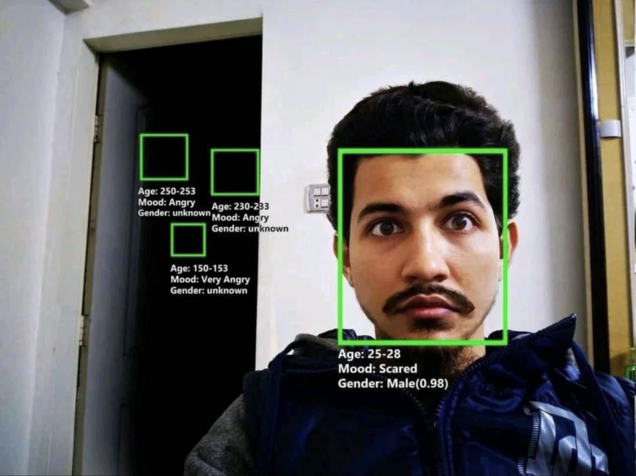

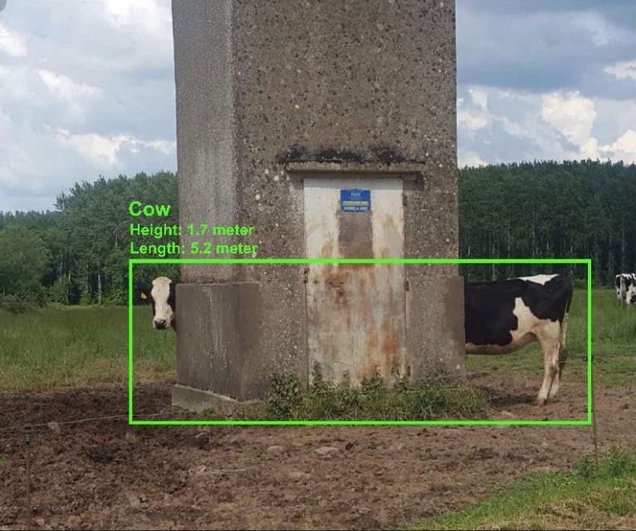

Eric Schmidt, ehemaliger CEO von Google hat eine klare Meinung. Eric Schmidt hält KI für so mächtig wie Atombomben. Deswegen hält er es für notwendig, ein ähnliches Abkommen wie den Atomwaffensperrvertrag auch für KI zu verhandeln. Dazu präsentieren wir zwei Bilder, die uns dann doch wieder ruhig schlafen lassen:

Deepfakes

Nicht erst seit dem Telefonat von Berlins Bürgermeisterin Franziska Giffey und dem falschen Vitali Klitschko sind Deepfakes ein Thema. Thomas Carlson, Associate Professor am Institut für Psychologie der University of Sydney, hat nun untersucht, wie das menschliche Gehirn realistische, künstlich erzeugte Bilder kodiert und interpretiert. Dazu wurden mittels EEG Gehirnaktivitäten gemessen. Dabei fanden die Forscher heraus, dass das Gehirn Deepfakes erkennen kann und man künstlich erzeugte Gesichter anhand der neuronalen Aktivität von Menschen zuverlässig entschlüsseln kann.

Dall-E 2

Text-2-Picture Systeme erfreuen sich weiter großer Beliebtheit und wir haben in den letzten Ausgaben immer wieder darüber berichtet. In diesem Zusammenhang haben wir auch immer wieder das Thema Bias aufgegriffen. Dabei lernt ein Algorithmus z.B. Vorurteile, die in den Trainingsdaten stecken. So zeichnet die Google Bildersuche bei der Suche nach CEO eher ein männliches Bild des Berufes und auch Dall-E 2 von OpenAI generiert solche Bilder. Dagegen will OpenAI jetzt vorgehen, wie sie in einem Blogpost berichten. Ziel ist es, bei geschlechtsneutralen Anfragen auch eine diverse Antwort zu geben. Wie genau das System das umsetzt, ist nicht klar, ein Hinweis ist aber, dass das System das Feedback von Nutzern verwendet, um hier Fortschritte zu erzielen.

Raphaël Millière, ein Forscher an der Columbia University in New York, hat Tests durchgeführt, wie robust Text-2-Picture Systeme wie Dall-E 2 sind, wenn sie mit Nonsenswörtern gefüttert werden. Die Idee orientiert sich an den Arbeiten zu Adversarial Attacken bei Bildanalysesystemen, wo kleine Änderungen am Bild die KI in große Probleme gestürzt hat. Dazu kreierte er Wörter, die aus der Kombination des Wortes übersetzt in andere Sprachen bestehen. So wurde aus cliff die Kombination Klippe in Deutsch, scogliera in Italienisch, falaise in Französisch und acantilado in Spanisch: falaiscoglieklippantilado.

Zu seiner Überraschung ergab die Eingabe dieses Wortes in DALL-E 2 eine Reihe von Bildern von Klippen. Er erstellte andere Wörter auf die gleiche Weise mit vergleichbaren Ergebnissen. Eine Erklärung ist, dass in der Trainingsmenge auch viele Bilder drin sind, die die Wörter in den anderen Sprachen beinhalten, somit leistet das System hier eine Übersetzungsleistung. Ob man das als erfolgreichen Angriff auf ein System beschreiben kann, ist unklar. Was aber möglich sein kann, ist die Aushebelung von Contentfiltern, indem man die solch konstruierten Wörter nutzt.

Lesestoff

Zum Abschluss noch ein Hinweis auf ein weiteres NLP Buch “Deep Learning for Natural Language Processing: A Gentle Introduction”, das auch mit Codebeispielen unterstützt. Viel Spaß beim Lesen.

In unserer monatlichen Serie “KI-Journal Club” stellen wir wissenschaftliche Beiträge und Presseberichte vor aus den Bereichen Text Mining, Machine Learning, KI, Natural Language Processing.

Datum: 31.08.2022